DeepSeek + Dify企业化AI 部署实践

本文将带领大家本地部署 DeepSeek+Dify,零成本搭建自己的私有知识库以及企业的私人 Agent。学会本文搭建方法后,我们也可以把自己的个人资料,过往输出文章,日记等所有个人信息上传到本地知识库,打造自己的私人助理。

下载安装 Docker

一路点击下一步安装即可,因为docker会用到hyper-v,如果电脑没开启hyper-v,可能会需要重启一次。

下载ollama

Ollama 是一个开源的本地化工具,旨在简化大型语言模型(LLMs)的本地运行和部署。它专注于让用户能够轻松在个人计算机或服务器上运行多种开源语言大模型(如deepseek ,qwen,Llama、Mistral、Gemma等),而无需依赖云端服务或复杂的配置流程。

网址:ollama.com/

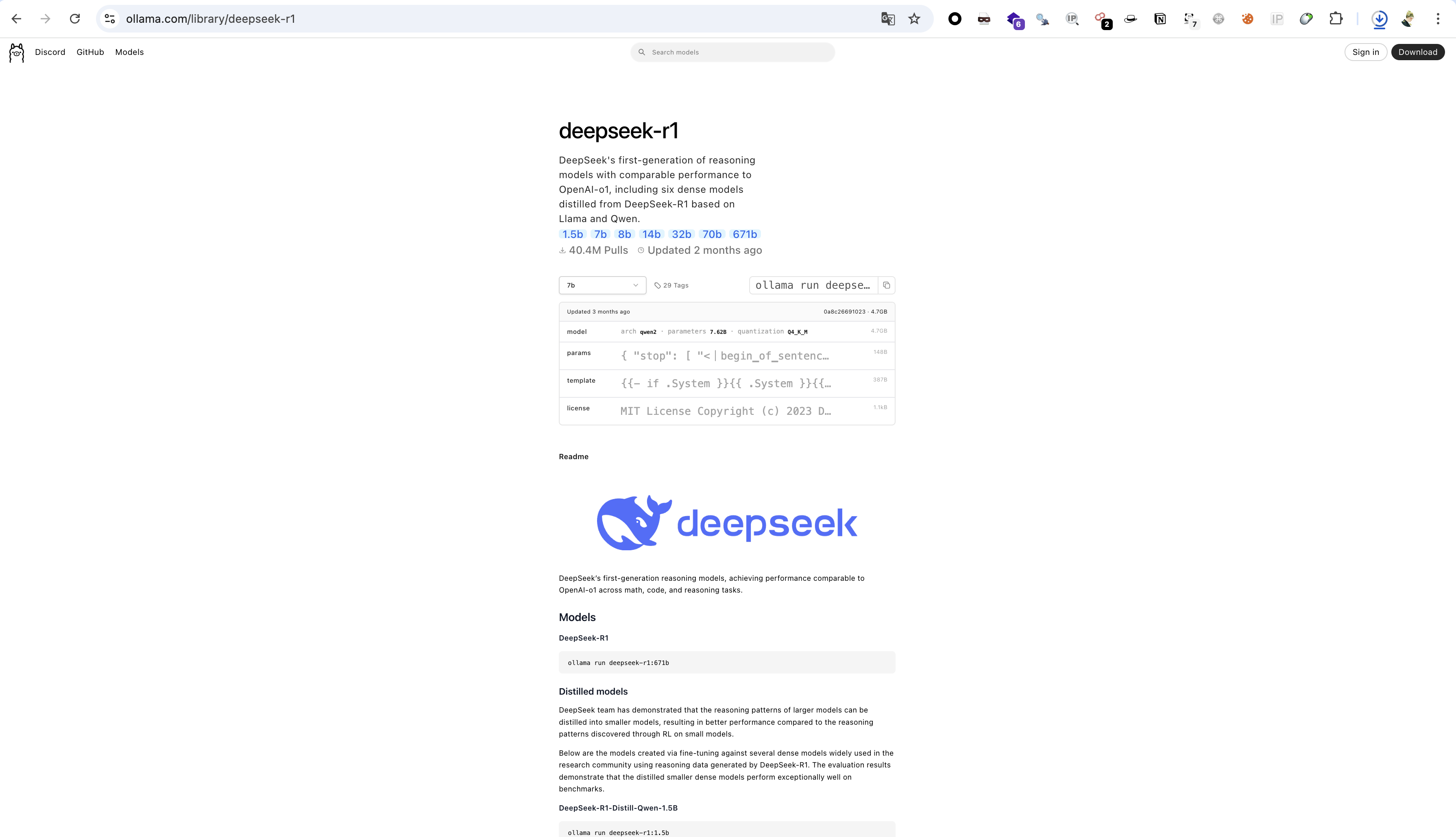

安装deepseek-r1模型

找到模型

在ollama官网首页的搜索框,点击一下即可看到deepseek-r1在第一个位置,可见热度之高啊!

可以看到模型有根据参数分为1.5b,7b,8b,14b,32b,70b,671b等,我们需要根据自己电脑选择下载对应参数的模型。

如何选择适合自己电脑的模型

查看自己的电脑配置,让Deepseek 帮忙选择下

我现在正在Mac使用ollama部署deepseek-r1模型,但是模型分为1.5b,7b,8b,14b,32b,70b,671b等,我不知道该怎么选择适合我电脑配置模型了,我现在把我电脑的配置信息告诉你,你帮我选择一下吧 |

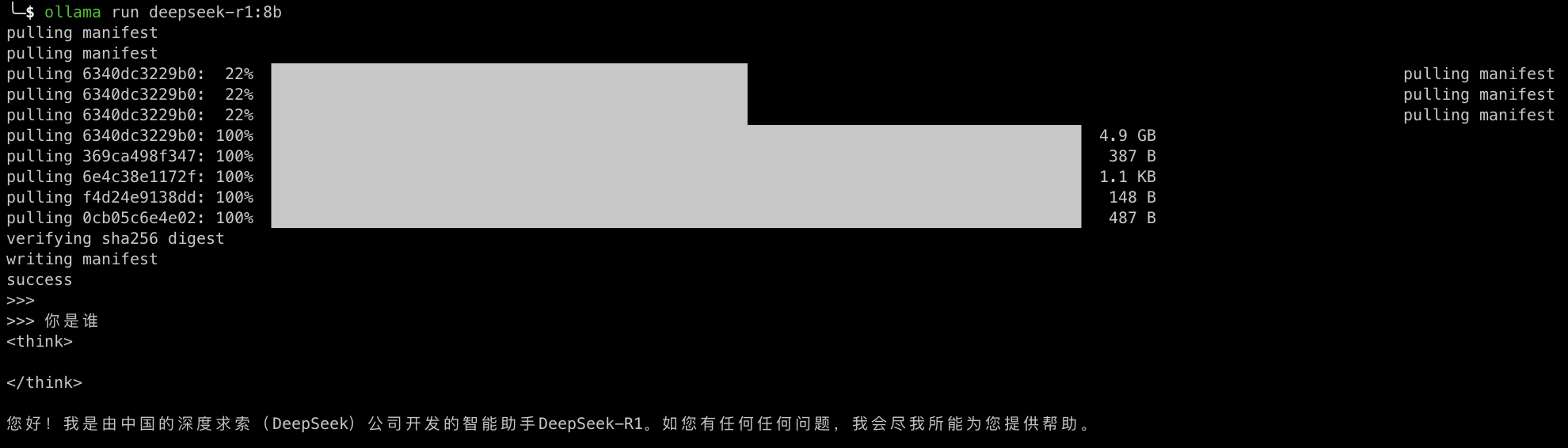

安装r1 模型

ollama run deepseek-r1:8b |

安装 Dify

这里简单介绍一下dify,需要详细了解的可以看dify的官网或官方文档。

Dify.AI 是一个开源的大模型应用开发平台,旨在帮助开发者轻松构建和运营生成式 AI 原生应用。该平台提供从 Agent 构建到 AI workflow 编排、RAG 检索、模型管理等全方位的能力,使开发者能够专注于创造应用的核心价值,而无需在技术细节上耗费过多精力。

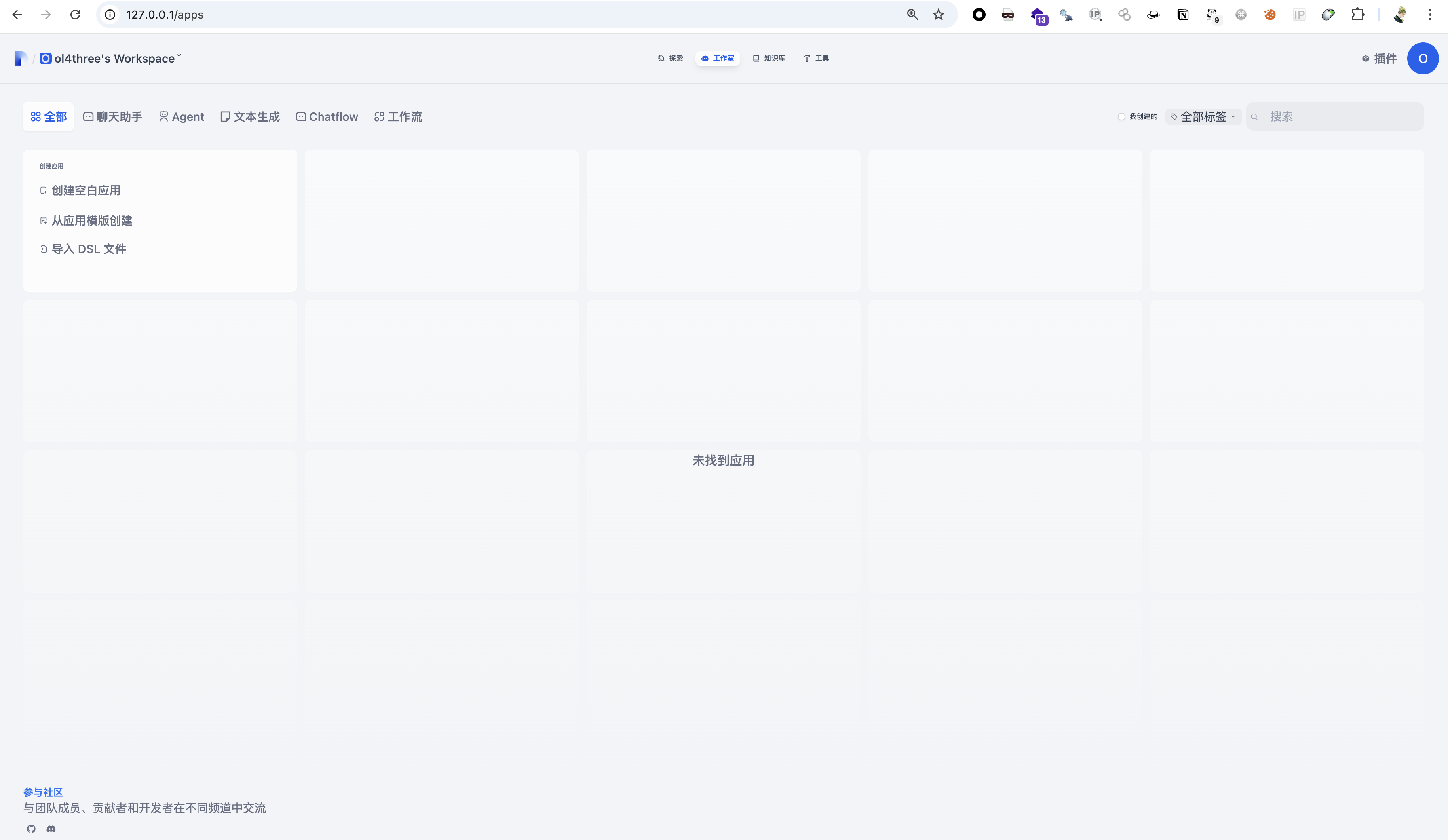

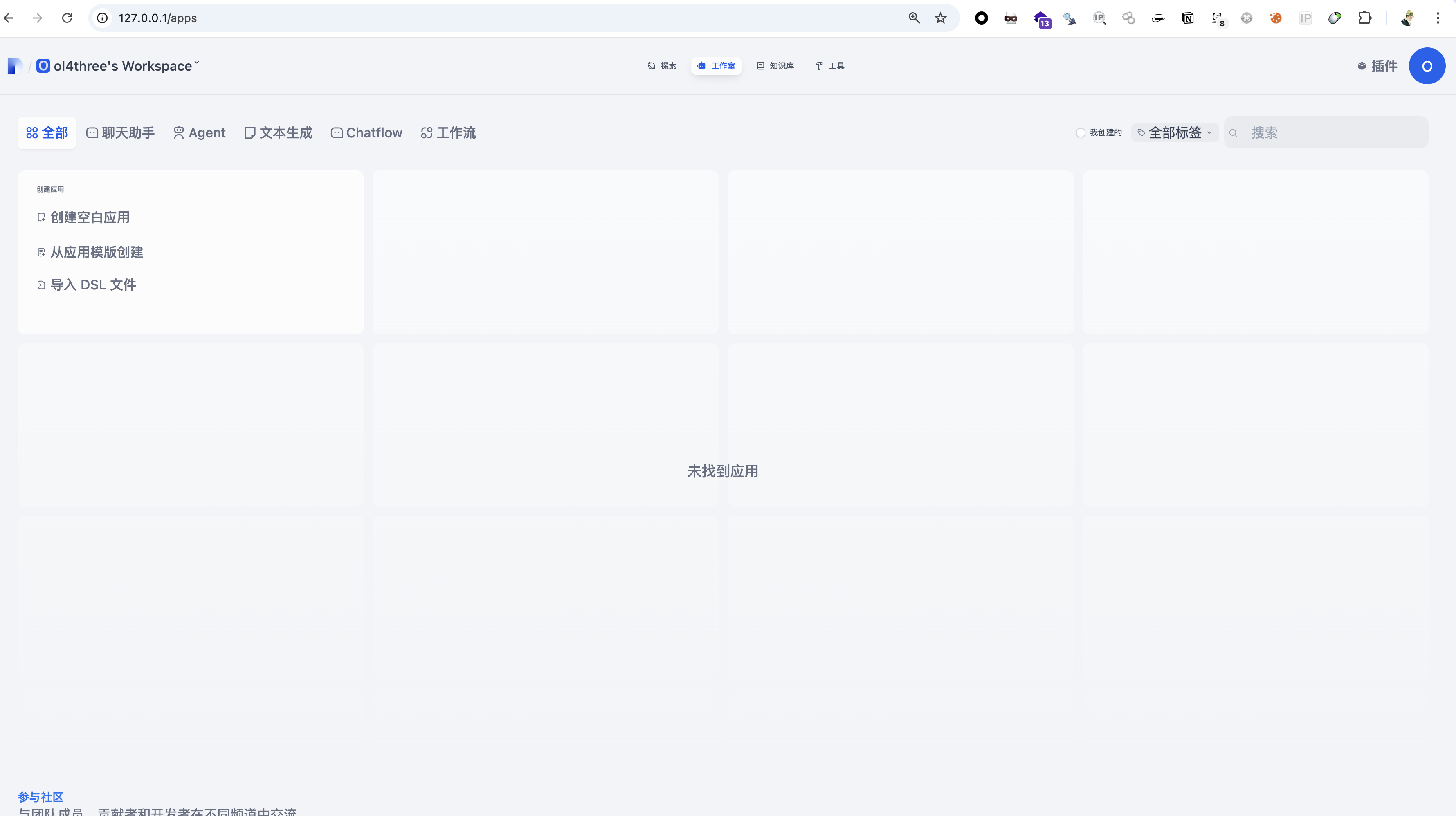

从创建应用页面可以看到,他可以创建:聊天助手,Agent,文生文应用,对话工作流,任务编排工作流等

git clone https://github.com/langgenius/dify |

在最下面添加一行

# 启用自定义模型 |

访问页面设置管理员账号密码

http://127.0.0.1/install |

进入主界面如下

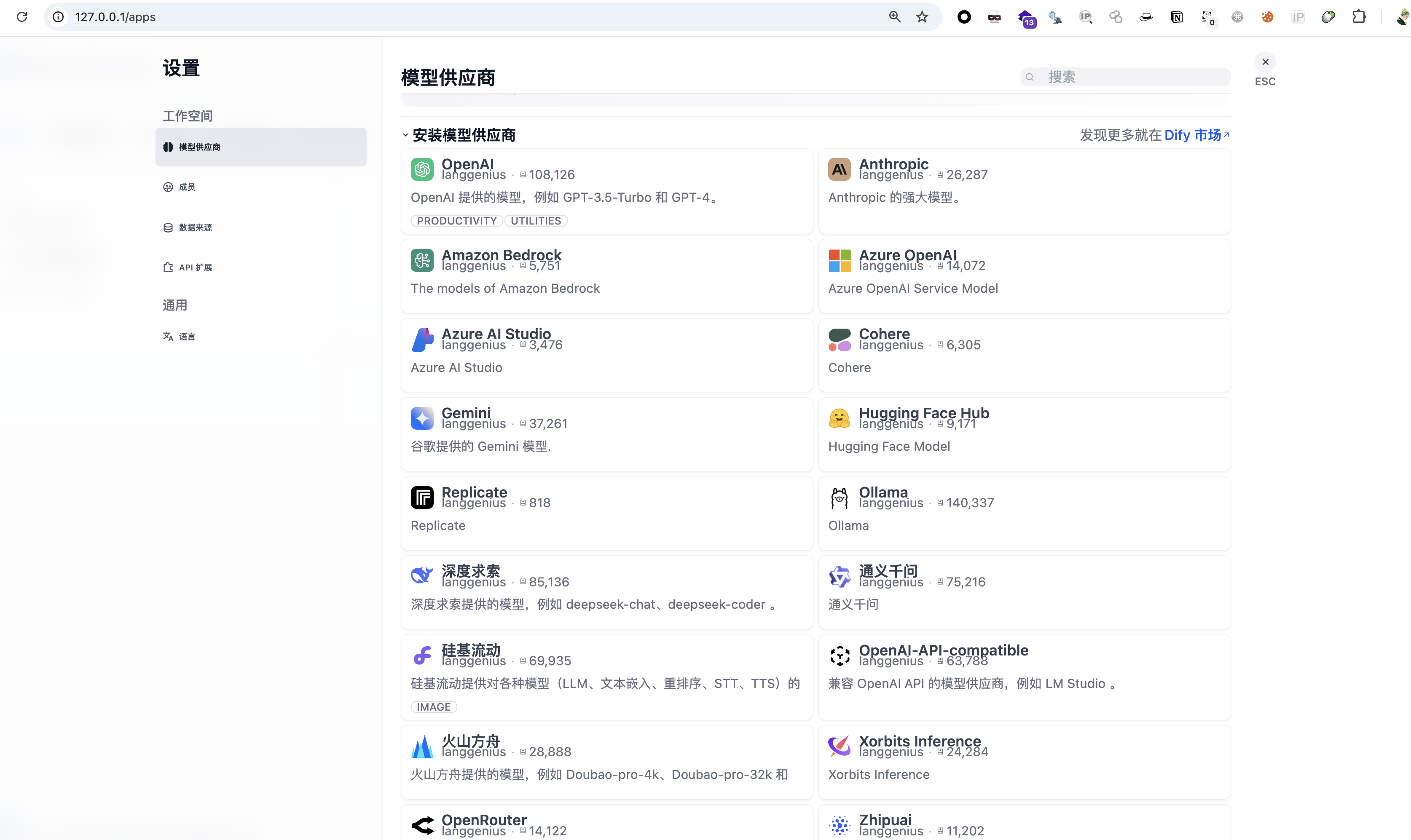

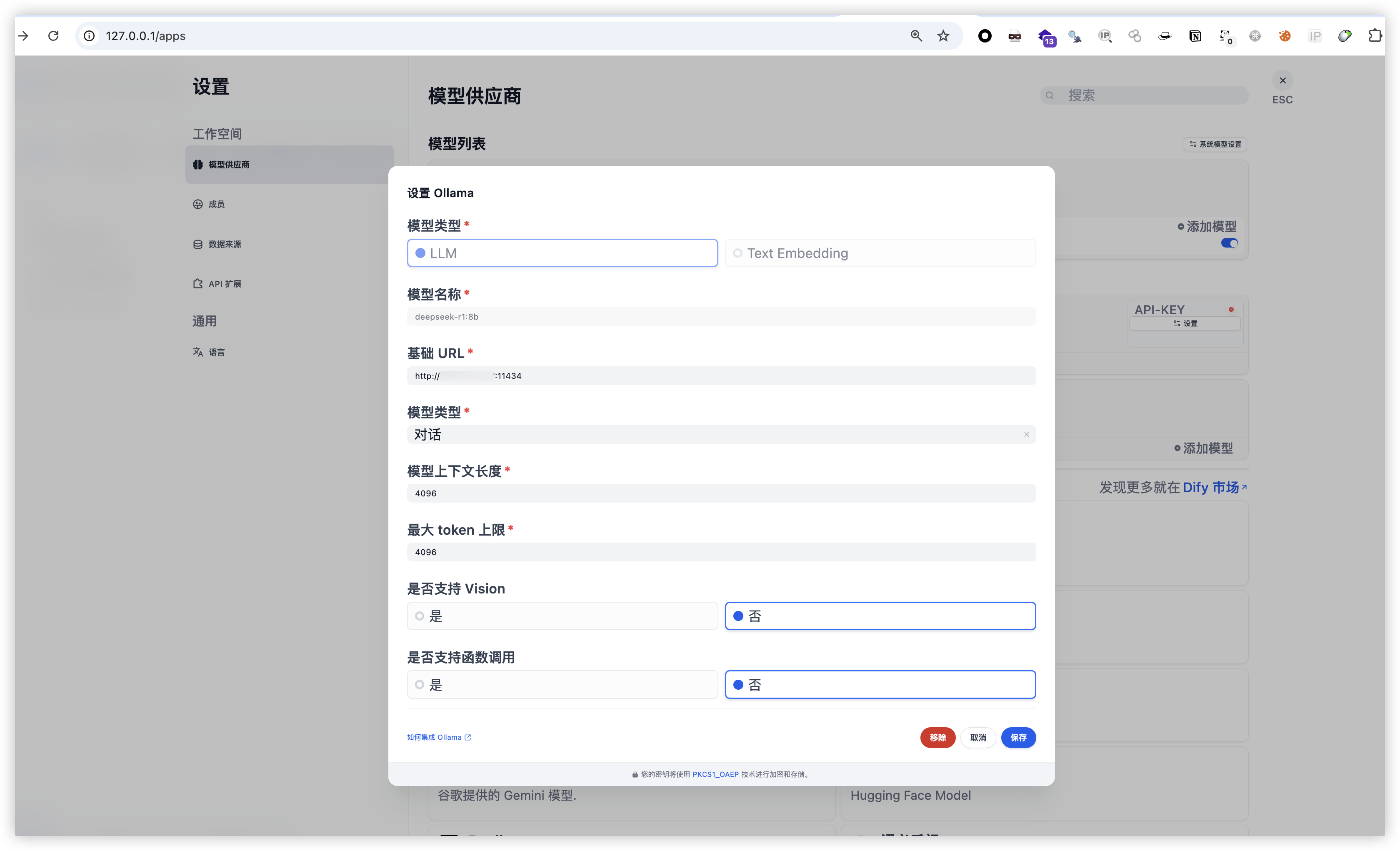

配置大模型

在配置界面配置你本地的大模型应用

创建应用

创建本地知识库

一)添加Embedding模型

1、为什么要添加Embedding模型?

Embedding模型的作用是将高维数据(如文本、图像)转换为低维向量,这些向量能够捕捉原始数据中的语义信息。常见的应用包括文本分类、相似性搜索、推荐系统等。

我们上传的资料要通过Embedding模型转换为向量数据存入向量数据库,这样回答问题时,才能根据自然语言,准确获取到原始数据的含义并召回,因此我们需要提前将私有数据向量化入库。

2、下载 Embedding 模型

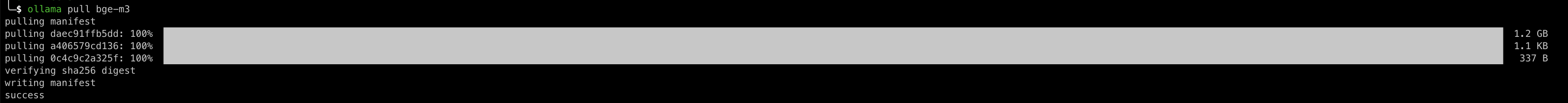

ollama pull bge-m3 |

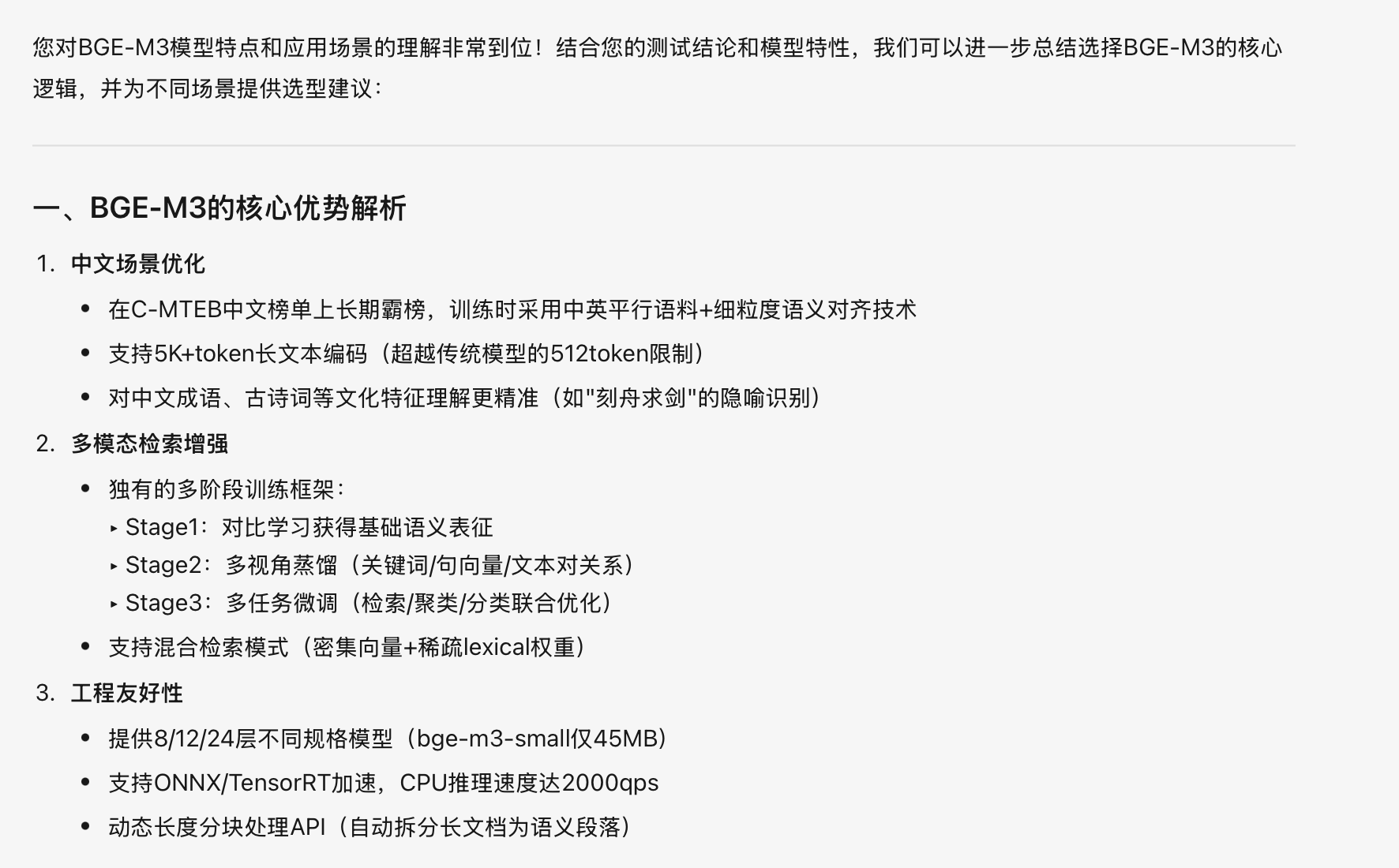

Embedding 模型那么多,为什么选择bge-m3 ?

BGE (BAAI General Embedding) 专注于检索增强llm领域,经本人测试,对中文场景支持效果更好,当然也有很多其他embedding模型可供选择,可以根据自己的场景,在ollama上搜索“embedding”查询适合自己的嵌入模型。

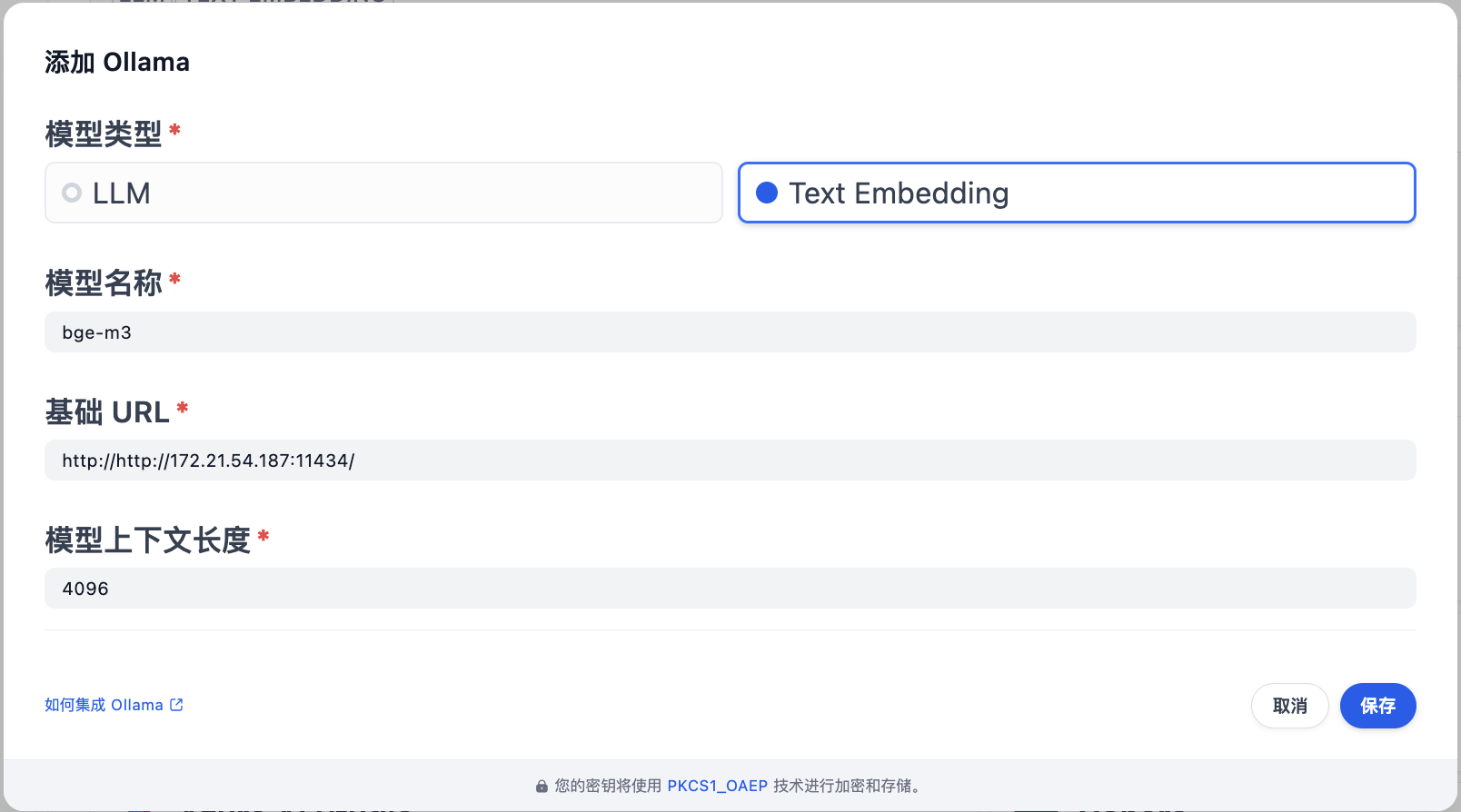

3、配置 Embedding 模型

配置成功之后便可以在知识库进行对应文档的创建